Content

[TOC]

定位技术简介

定位+高精度地图:提供当前位置的静态环境感知( 车道线/交通指示牌/红绿灯/柱子/建筑物/等)

定位+动态物体感知:将感知到的动态物体正确放入静态环境

定位获取位置姿态:用于路径规划/决策

定位技术分类

- 场景:室内(房间,车库,仓库等)室外()

- 基于感知模式

- outside-in: 接收的外界信号包含位置相关信息/ GNSS UWB WIFI Lidar Hdmap Camera-marker(室外街景门牌室内 maker)磁条加marker(规划都做了)扫地机本身贴marker加顶部相机 / (适合测量方程)

- inside-out:通过自身观察和感受获取位置信息 / IMU magnetometer SLAM VR中的墙面贴marker建图 / (适合状态方程)

- 基于计算方法

- 基于信号的定位: GNSS UWB WIFI/几何关系

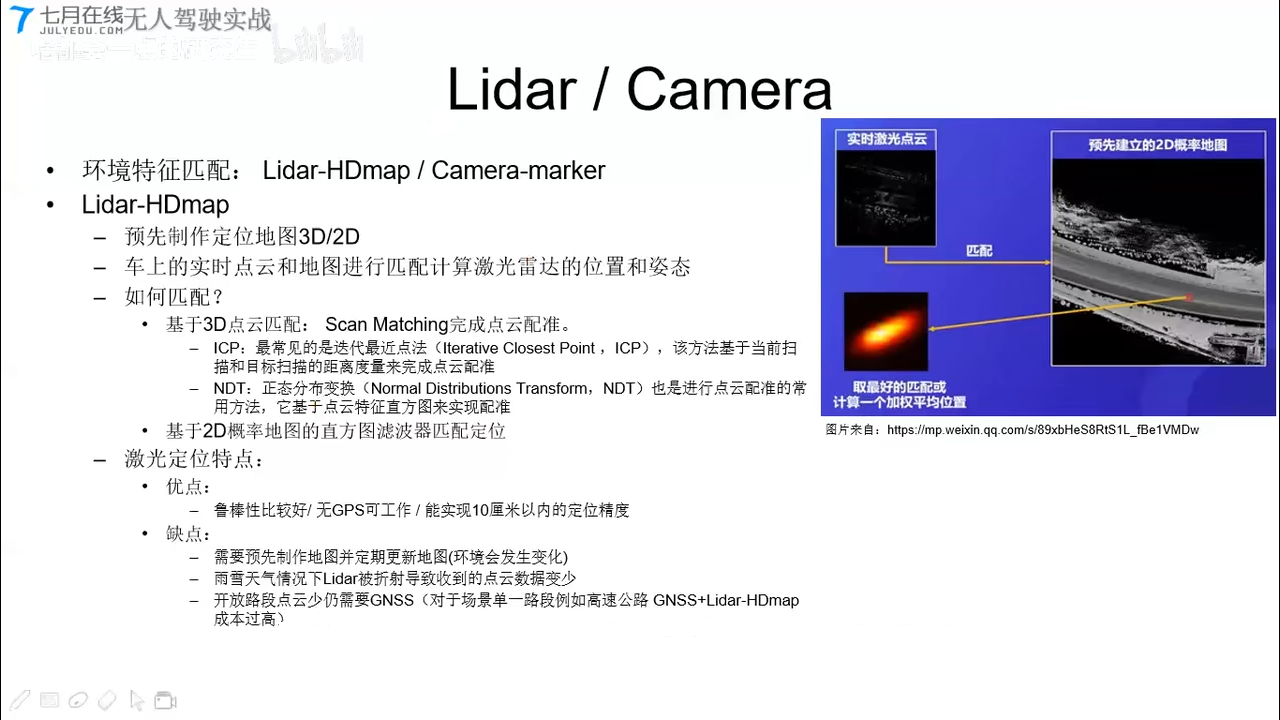

- 环境特征匹配: Lidar-HDmap Camera-marker Radar / 需要建图,观测特征与数据库的特征匹配得到当前位姿态

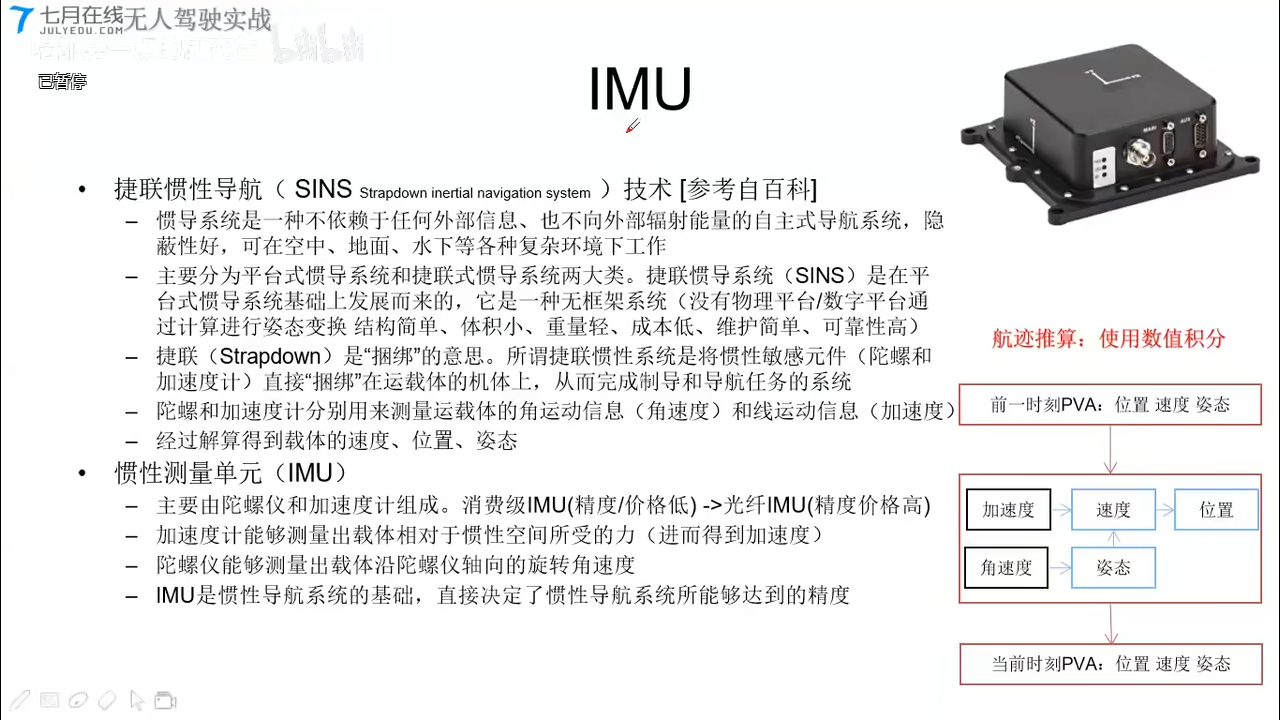

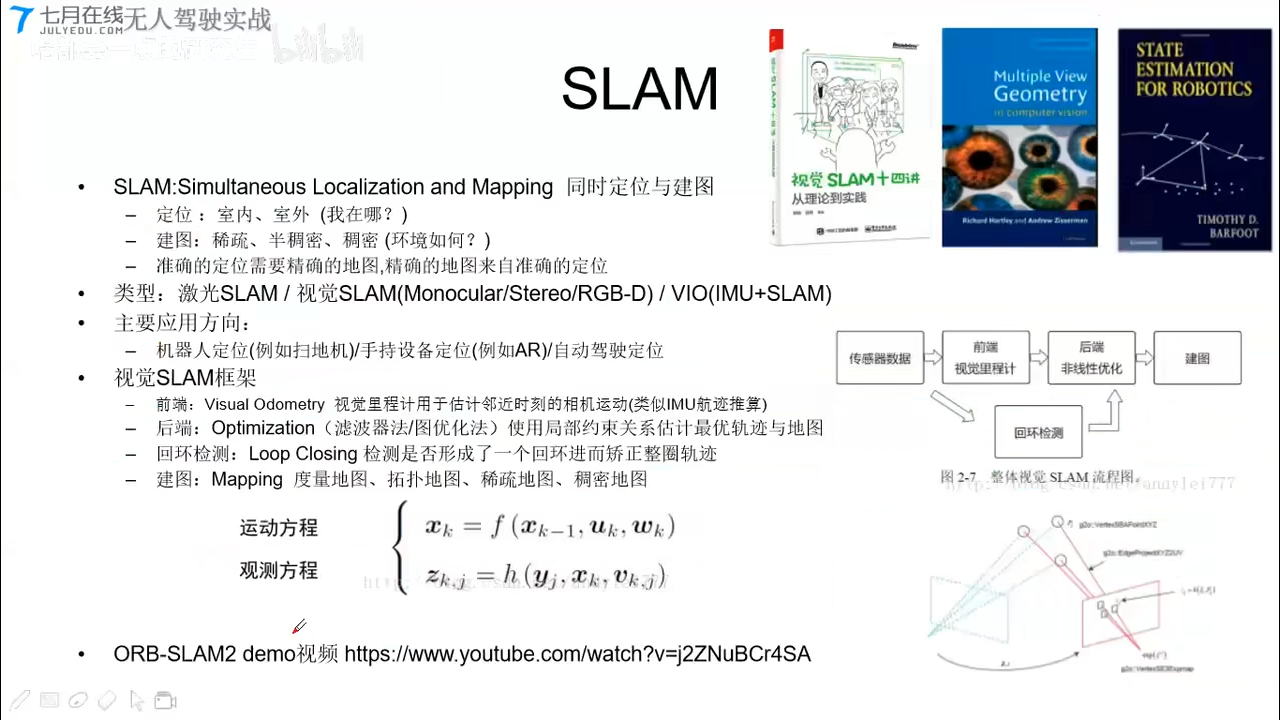

- 航迹推算:IMUodometry(轮子里程计/视觉里程计SLAM)/根据之前的位姿推断当前的位姿

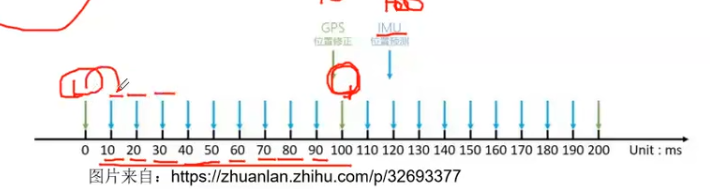

定位系统的融合

- 原理:不同源传感器信息通过滤波器(KF, EKF, UKF, PF等)进行融合

- 典型融合方式:

- IMU + GNSS :高频率累积误差+低频率高精度 无人机/无人车/导弹/室外

- GNSS + Lidar-HDMAP/Camera-marker:适合开放环境+适合密集特征环境 无人车/室内外

- VIO(SLAM+IMU+GNSS) 无人机/无人车/室内外

- IMU + magnetometer 矫正角度(互补滤波/MadgwickAHRS) 无人机/无人车/室内外

单个定位技术

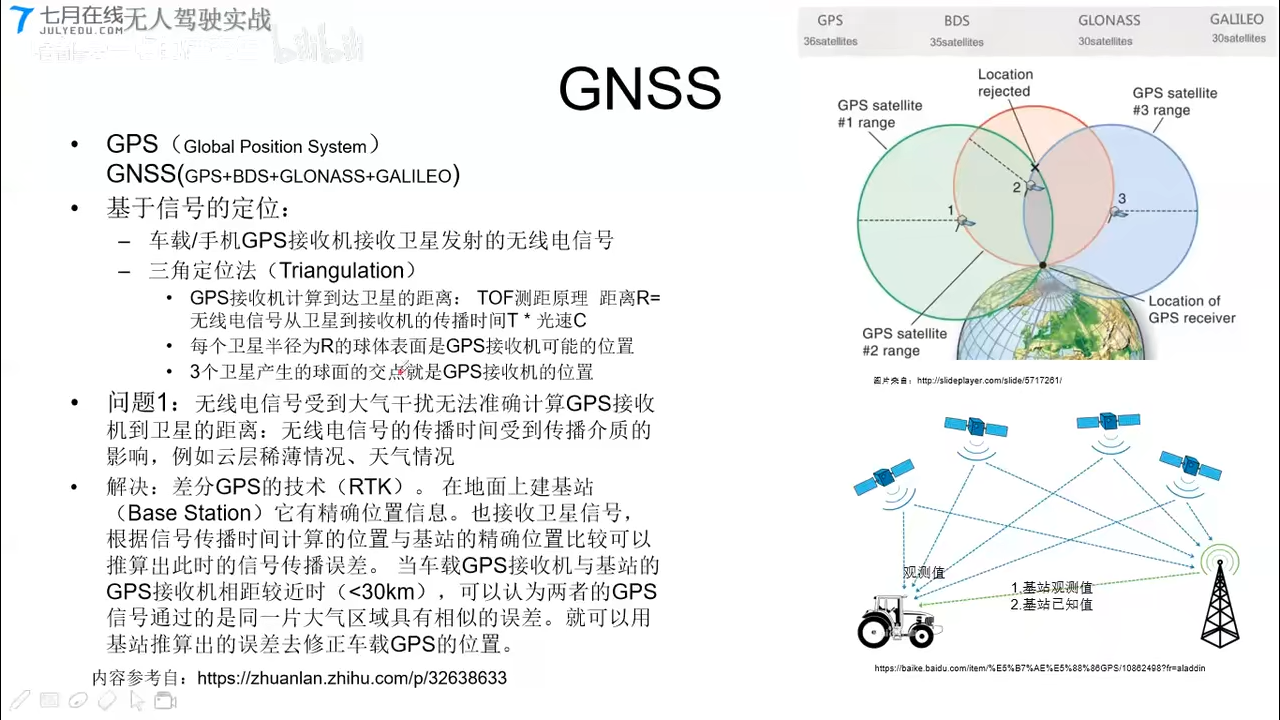

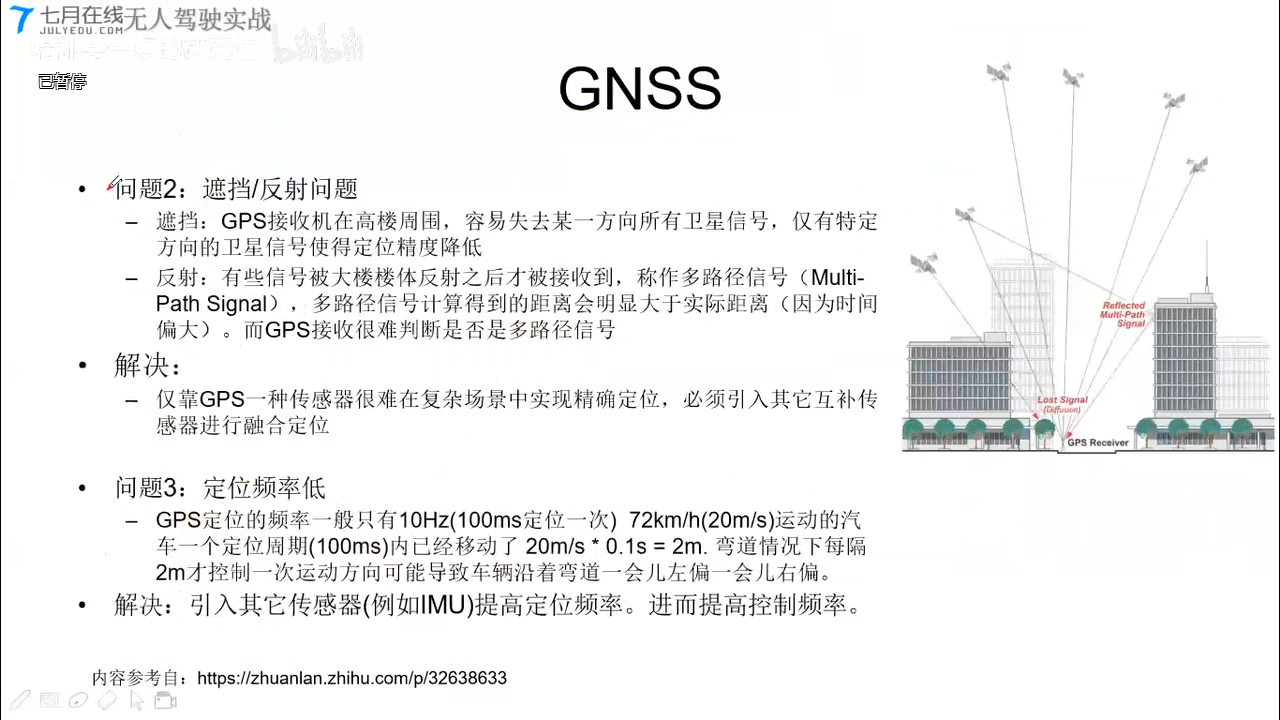

GNSS

IMU

Lidar / Camera

SLAM

定位融合技术

定位系统的融合

- 原理:不同源传感器信息通过滤波器(KF, EKF, UKF, PF等)进行融合

- 典型融合方式:

- IMU + GNSS :高频率累积误差+低频率高精度 无人机/无人车/导弹/室外

- GNSS + Lidar-HDMAP/Camera-marker:适合开放环境+适合密集特征环境 无人车/室内外

- VIO(SLAM+IMU+GNSS) 无人机/无人车/室内外

- IMU + magnetometer 矫正角度(互补滤波/MadgwickAHRS) 无人机/无人车/室内外

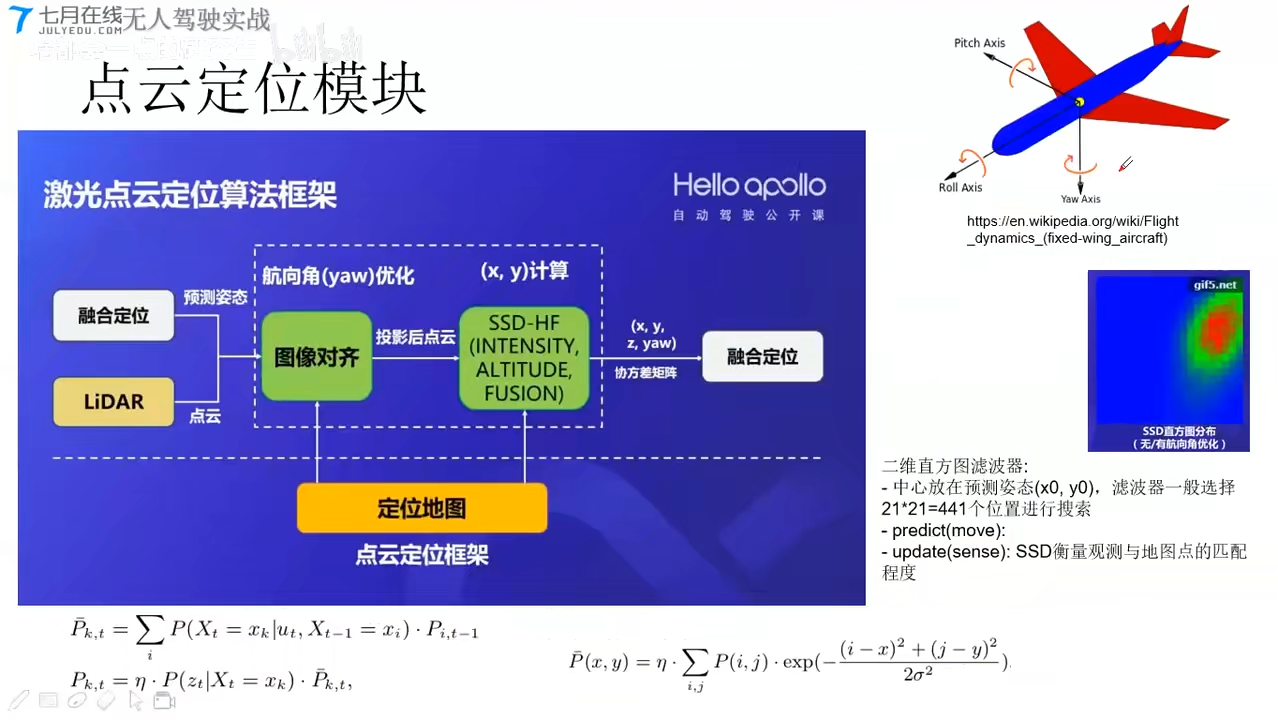

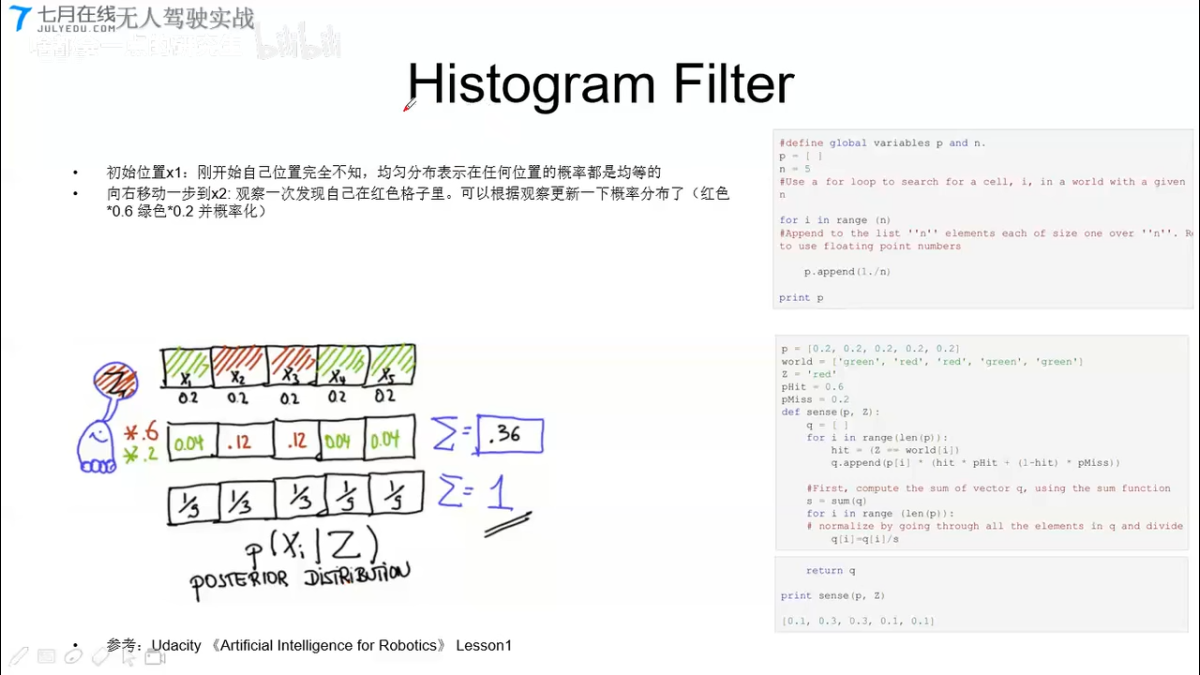

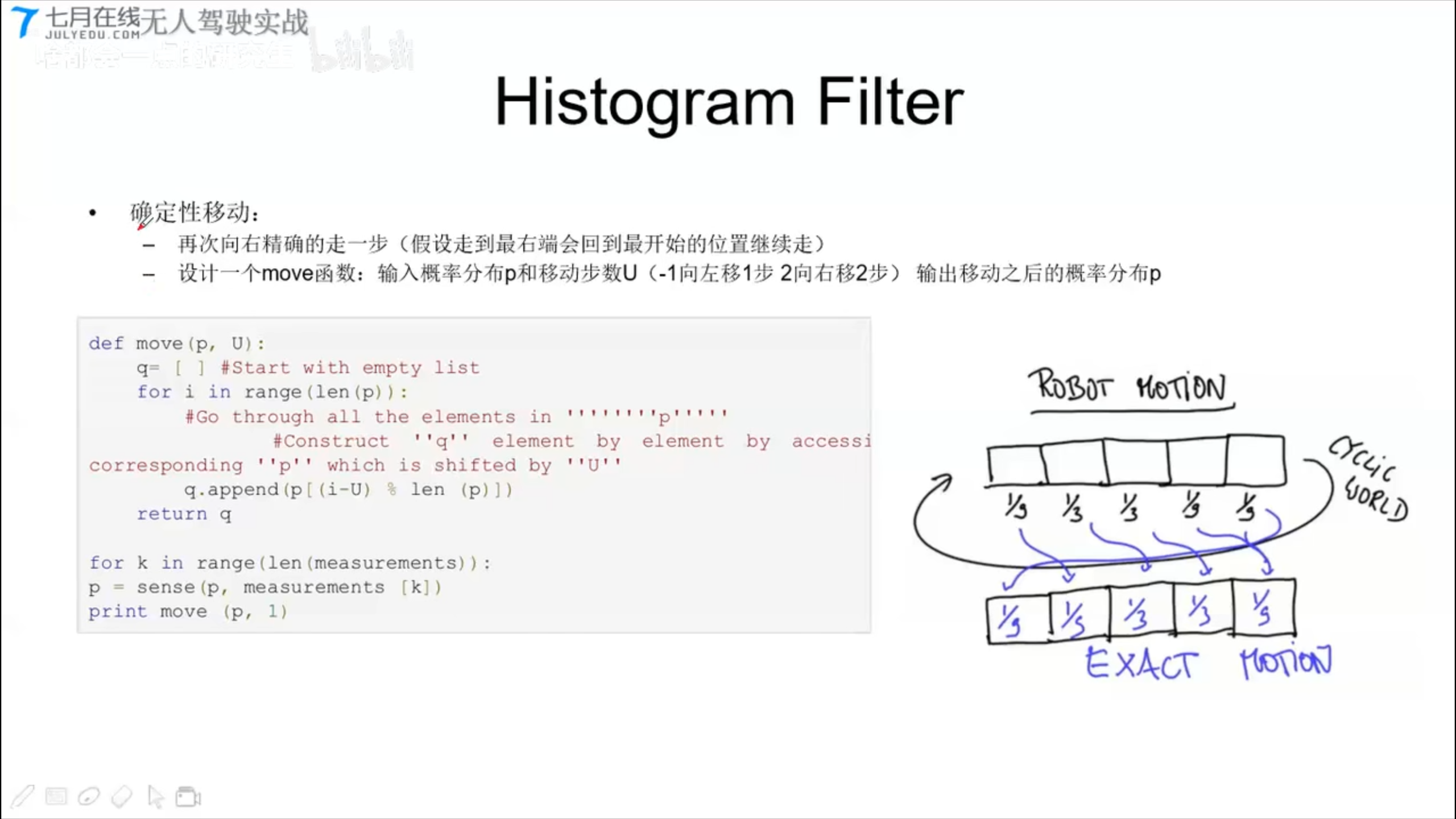

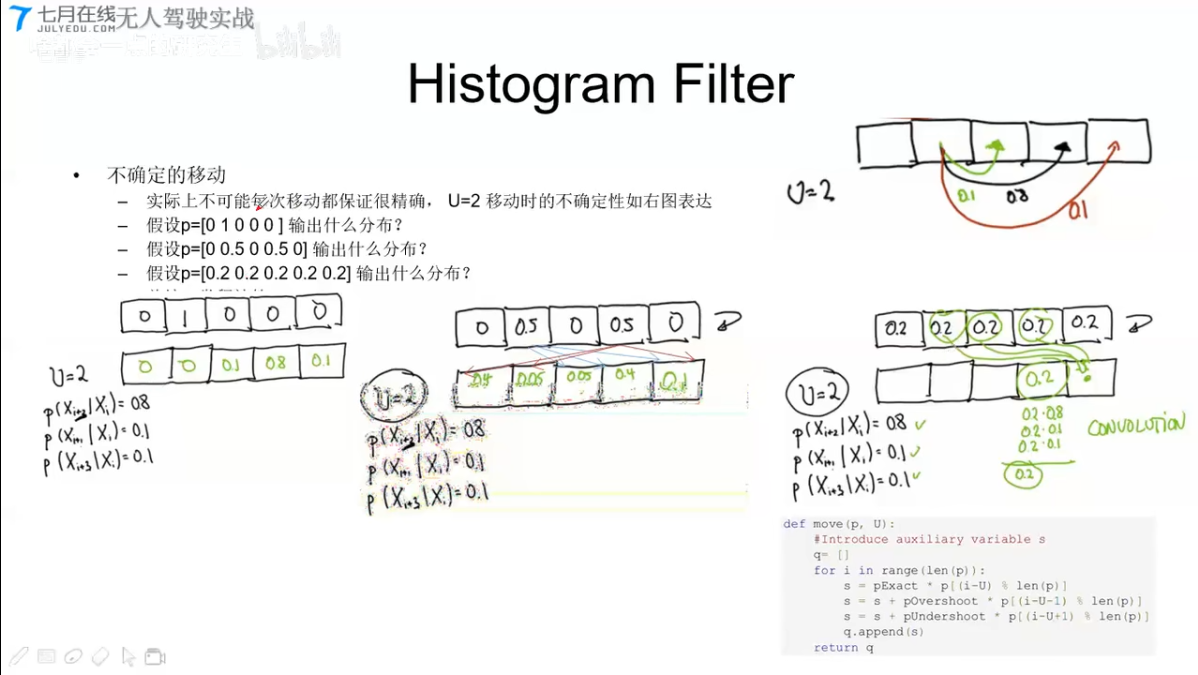

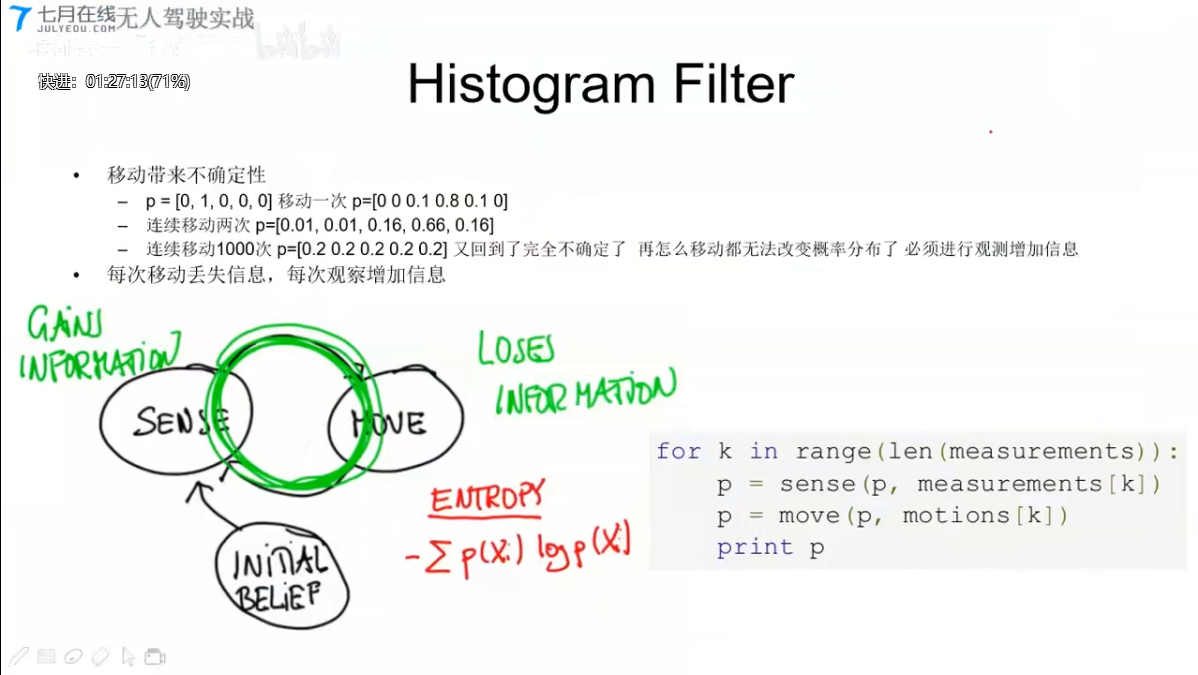

Histogram Filter

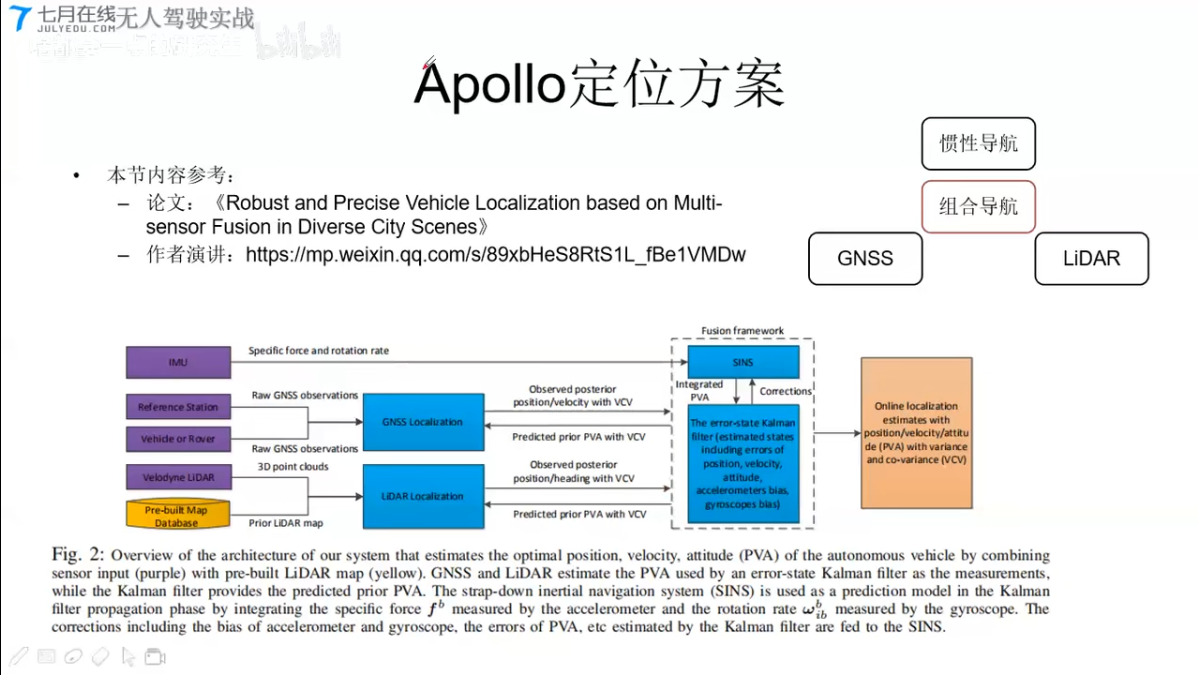

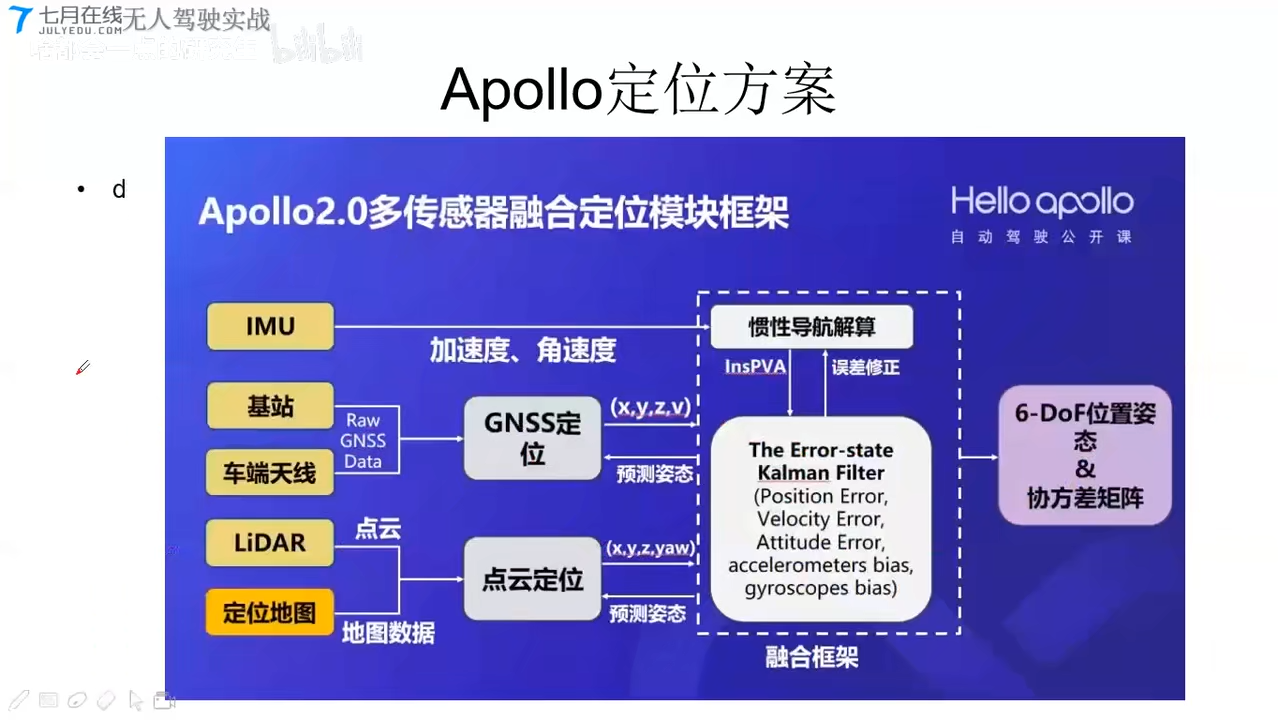

Apollo定位方案